作者:Rambus IP核产品营销高级总监Frank Ferro

随着数据中心对人工智能和机器学习(AI/ML)的利用率越来越高,大量数据不断被产生和消耗,这给数据中心快速而高效地存储、移动和分析数据提出了巨大挑战。

而中国的情况尤其如此:随着中国不断推进人工智能的发展,对高性能处理的需求持续增长,而传统数据中心已然成为必须解决的瓶颈。为应对这一挑战,中国公布了《新型数据中心发展三年行动计划》。与传统数据中心相比,新型数据中心具有高技术、高算力、高能效和高安全的特征。

在市场需求和产业政策支持的双驱动下,数据中心服务器迫切需要更大的内存带宽和容量,以更好地支持AI/ML的持续发展。

自2013年推出以来,高带宽存储器(HBM)日益被视为将数据中心服务器和AI加速器的性能提升至新高度的理想方式之一。HBM是一种基于3D堆栈工艺的高性能SDRAM架构,能够实现巨大的内存带宽。

2018年年底,JEDEC固态技术协会宣布了HBM2E标准,以支持更高的带宽和容量。HBM2E每个引脚的传输速率上升到3.6Gbps,可以实现每个堆栈461GB/s的内存带宽。此外,HBM2E高支持12个DRAM的堆栈高度,并且单堆栈内存容量高达24GB。

在HBM2E中,四个连接到处理器的堆栈将提供超过1.8TB/s的带宽。通过内存的3D堆叠,HBM2E可以在极小的空间内实现高带宽和高容量。在此基础上,下一代的HBM3内存将数据传输速率和容量推向了新的高度。

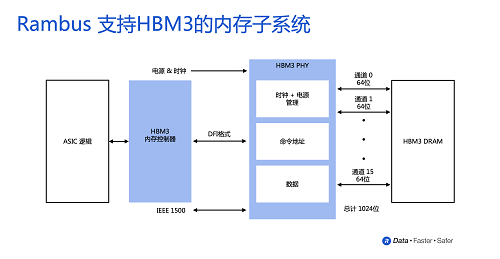

Rambus HBM3内存子系统针对高带宽和低延迟进行了专门优化,能够以紧凑的架构和高效能的封装提供最佳的性能和灵活性。这一解决方案由完全集成的PHY和数字控制器组成,包含完整的HBM3内存子系统。

相比HBM2E,Rambus HBM3内存子系统将大数据传输速率提高了一倍以上,达到每个数据引脚8.4Gbps(当此速度下的DRAM可用时)。该系统接口具有16个独立通道,每个通道包含64位,总数据宽度为1024位。在大数据传输速率下,可以提供1075.2GB/s的总接口带宽,换言之,带宽超过1TB/s。

这一内存子系统专为2.5D架构设计,带有一个内插器,以在SoC上的3D DRAM堆栈和PHY之间传输信号。同时,这种信号密度和堆叠架构的组合还要求特殊的设计考量。为提高设计的易实施性和灵活性,Rambus对整个2.5D架构的内存子系统进行了完整的信号和电源完整性分析,以确保满足所有的信号、电源和热量要求。除此之外,Rambus还提供中介层参考设计。

凭借在高速信号处理方面逾30年的专业知识,以及在2.5D内存系统架构设计和实现方面的深厚积淀,Rambus正引领HBM的演变。Rambus提供了业界最快的HBM2E内存子系统;如今通过数据传输速率高达8.4Gbps的HBM3内存子系统,Rambus更进一步地提高了HBM的带宽标准。