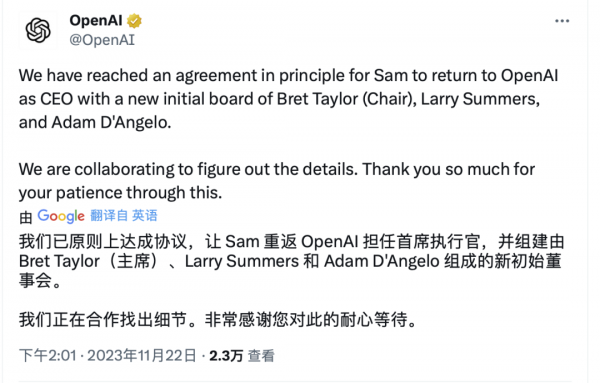

OpenAI“宫斗”在当地时间11月21日深夜又解锁了新剧情。在经过解雇CEO山姆·奥特曼,联合创始人兼前总裁格雷格·布罗克曼辞职,超95%员工签字威胁离职逼宫要求董事会辞职等一系列事件后,OpenAI宣布,已经原则上达成协议,创始人山姆·奥特曼重返公司担任CEO。奥特曼随后发文称,我期待着重返OpenAI,并巩固我们与微软的牢固合作伙伴关系。

分析指出,无论事件是否还会反转,都会对大模型的发展造成较大的影响,尤其是OpenAI人事动荡背后折射出的大模型安全问题更引人深思。

据分析,此次事件出现的根本原因在于OpenAI高层人工智能安全等理念的冲突。与OpenAI首席科学家苏茨克维非营利性理念不同,奥特曼一直致力于推动营利更大化,但对AI安全问题的重视程度显得略有不足,ChatGPT近期已出现多次宕机故障。

美东时间11月8日,因新功能上线流量过多,从早上9点开始,大量网友报告无法使用ChatGPT和API(应用程序编程接口)。故障时间持续了约2个小时;8日晚间,ChatGPT和API再次出现有时无法打开的问题。这次,OpenAI表示是受到了DDoS(分布式拒绝服务)攻击;11月12日,OpenAI再次表示,ChatGPT和其他一些服务出现故障。

分析认为,这些安全问题的爆发或许就是此次事件的导火索。奥特曼带领下的OpenAI商业营利属性越发明确,但安全方面的隐忧也在增强,最终导致与苏茨克维乃至整个董事会的矛盾加剧,出现后续一系列的动荡。这是公司发展理念的冲突,也反映出大模型快速发展下,安全问题可能比预想中更严重,已经到了必须解决至少是大幅度改善的程度。

想要做到这一点,重点是从导致安全问题产生的原因身上着手。需要采取一系列举措改变技术不成熟、数据质量低、对抗性攻击、透明度低等,尤其是要提升支撑人工智能运作的智算中心的可靠性。

智算中心是指通过使用大规模异构算力资源,包括通用算力和智能算力,主要为人工智能应用提供所需算力、数据和算法的设施。智算中心是大模型进行开发、训练、推理的基础,是用户使用大模型产品的底座。一旦智算中心出现故障,大模型软件便可能面临宕机瘫痪的状态。

根据实际来看,影响智算中心可靠性的因素包括多个方面,想要保障安全稳定性,需要提升智算基础设施的建设运维能力、网络安全能力、智算供给能力等,这其中涉及到芯片的选择应用、智算中心的制冷情况、网络传输可靠性等,是一项复杂的系统工程。

定于2023年12月13日在北京国家会议中心举行的第十八届中国IDC产业年度盛典(IDCC2023)数据中心服务稳定与可靠性专题论坛拟邀请业内专家、行业分析师、算力基础设施建设厂商代表、安全企业代表、设备厂商、网络供应商、算力调度服务商等,基于安全基本需求,通过案例、产品、应急方案的分享,风险的预估及防范,有效提升智算中心服务安全可靠性,以降低软件故障率,更好地服务于社会生产、生活。(点击链接:http://idcc.idcquan.com/ticket.html,或扫码二维码即可报名参会。)

扫描上方二维码报名